Blog Introl

**

Introl Blog **

Boom des centres de données d'IA en Afrique : opportunités au Nigeria, au Kenya et en Afrique du Sud

L'Afrique est en train d'émerger comme la prochaine frontière majeure de l'infrastructure de l'IA dans le monde, menée par les marchés à croissance rapide du Nigéria, du Kenya et de l'Afrique du Sud. Avec des milliards qui affluent dans les régions de cloud, les câbles sous-marins, l'énergie renouvelable et les centres de données à grande échelle, le continent s'accélère dans une nouvelle ère d'expansion numérique. Une population jeune et mobile et l'adoption rapide de la fintech alimentent cette transformation, créant une forte demande pour les services de calcul, de connectivité et de cloud. Pour les investisseurs, l'Afrique offre une croissance précoce rare sur un marché en passe d'atteindre 5 milliards de dollars d'ici 2027.

Infrastructure d'IA en Amérique latine : Opportunités pour les centres de données au Brésil et au Mexique

São Paulo est en train de devenir la capitale des centres de données en Amérique latine, avec une capacité de 100 MW. Le boom du nearshoring au Mexique attire 50 milliards de dollars d'investissements étrangers. L'engagement de 10 milliards de dollars d'AWS dans l'infrastructure cloud mexicaine signale également des opportunités sans précédent sur le marché de l'IA en Amérique latine. Le Brésil compte 215 millions de citoyens générant la plus grande économie numérique de la région, d'une valeur de 200 milliards de dollars.

Infrastructure Edge AI : Déployer des GPU au plus près des sources de données

Déployer des GPU de pointe pour réduire la latence de 95 % et la bande passante de 82 %. De la sélection des Jetson aux T4, des contraintes de puissance et des implémentations réelles. Guide complet.

Construisez votre équipe d'infrastructure d'IA : Feuille de route de certification de NVIDIA pour 2025

La pénurie de 85 000 ingénieurs GPU fait grimper les salaires à plus de 350 000 dollars. NVIDIA ne certifie que 12 000 ingénieurs par an contre 97 000 pour la demande. Constituez votre équipe à l'aide de cette feuille de route pour 2025.

Révolution de l'IA au Moyen-Orient : Les plans d'infrastructure des Émirats arabes unis et de l'Arabie saoudite s'élèvent à plus de 100 milliards de dollars

Le NEOM de 500 milliards de dollars de l'Arabie saoudite, le ministre de l'IA des Émirats arabes unis et le fonds numérique de 10 milliards de dollars du Qatar illustrent des approches régionales distinctes de la croissance tirée par l'IA. Soutenus par les 3 000 milliards de dollars de richesses du Golfe, les investissements dans l'infrastructure de l'IA dépasseront les 100 milliards de dollars d'ici à 2030. Des géants mondiaux de la technologie comme Microsoft, Oracle et AWS engagent des capitaux considérables. Cette analyse compare les stratégies nationales et montre comment le marché émergent de l'IA au Moyen-Orient offre des modèles nationaux uniques et des opportunités transfrontalières.

Google TPU v6e vs GPU : Guide de l'IA 4x plus performante par dollar

Google TPU v6e offre des performances quatre fois supérieures à celles des GPU pour l'apprentissage de l'IA. Découvrez les stratégies de déploiement, l'analyse des coûts et les cas d'utilisation optimaux.

40-250 kW par baie : solutions pour centres de données à densité extrême

L'IA moderne demande 40 à 250 kW par rack alors que le refroidissement traditionnel ne fonctionne qu'à partir de 15 kW. Découvrez les solutions d'ingénierie pour le déploiement d'infrastructures à densité extrême.

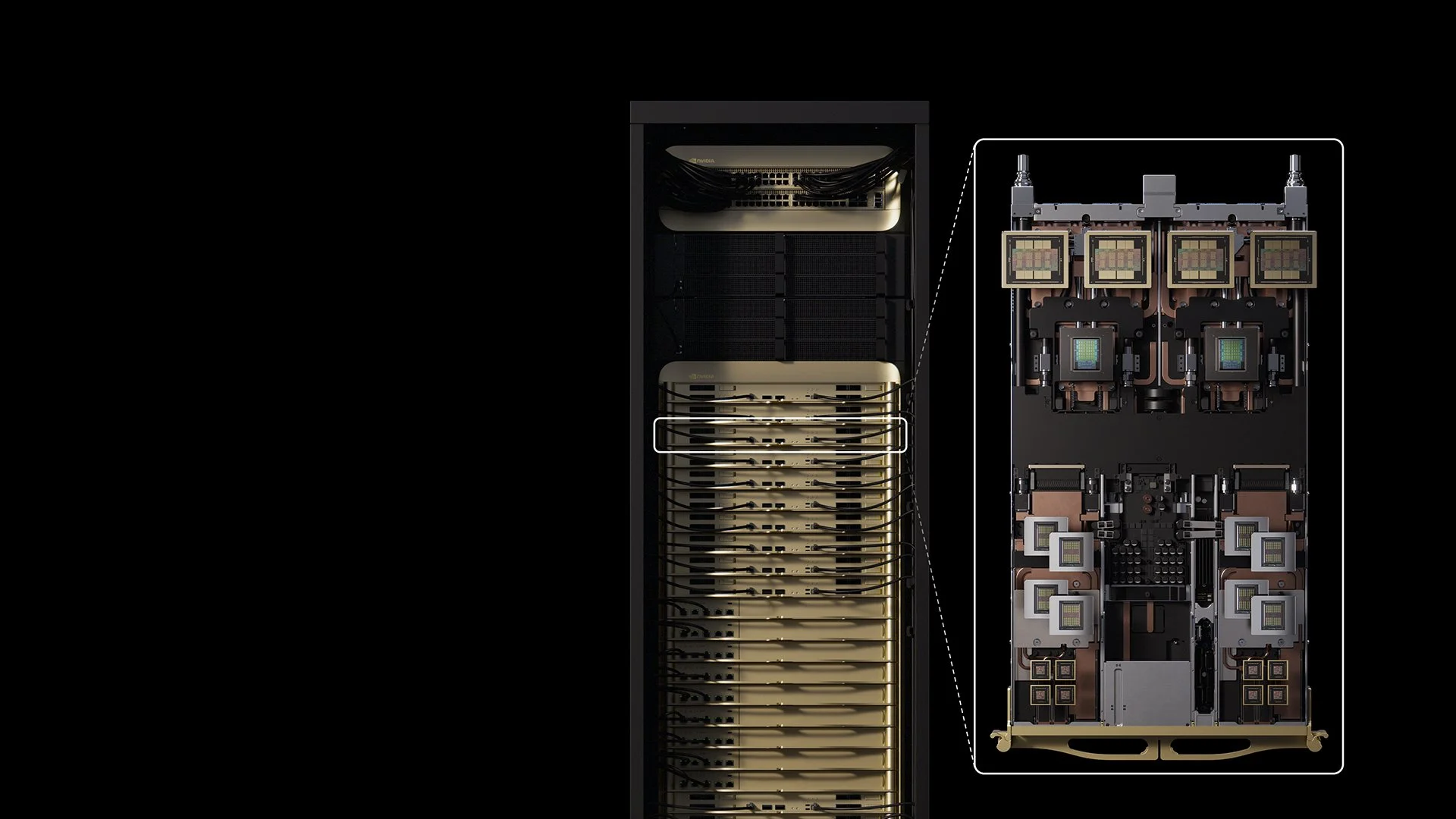

Accord OpenAI-NVIDIA de 100 milliards de dollars : une infrastructure d'IA de 10 gigawatts

OpenAI et NVIDIA annoncent un partenariat de 100 milliards de dollars pour déployer une infrastructure d'IA de 10 gigawatts, la plateforme Vera Rubin fournissant huit exaflops à partir de 2026.

VVater et Introl annoncent un partenariat pour redéfinir l'avenir des centres de données d'IA

VVater et Introl s'associent pour révolutionner les centres de données d'IA grâce à une technologie de l'eau durable. 4,3 milliards de gallons traités, 80 % d'économies OpEx pour la mise à l'échelle de l'infrastructure GPU.

NVIDIA Vera Rubin brise le moule des GPU avec des racks de 600 kilowatts et des mémoires d'un million de jetons.

NVIDIA Vera Rubin pousse les centres de données à atteindre des baies de 600 kW d'ici 2027, ce qui permettra de multiplier les performances par 7,5 tout en exigeant une transformation complète de l'infrastructure.

CoreWeave : La révolution de l'infrastructure de l'IA - Comment une startup de minage de crypto-monnaie est devenue l'épine dorsale de l'intelligence artificielle, d'une valeur de 23 milliards de dollars

CoreWeave est passé de l'extraction de crypto-monnaies à une infrastructure d'IA de 23 milliards de dollars, enregistrant une croissance de 737 % de son chiffre d'affaires tout en alimentant les modèles de base de l'OpenAI.

Guide local du matériel LLM 2025 : Prix et spécifications

La double RTX 5090 correspond aux performances de la H100 pour les modèles 70B à un coût de 25 %. Guide complet des prix du matériel pour le déploiement local du LLM, des GPU grand public aux GPU d'entreprise.

La porte des étoiles d'OpenAI : Une coentreprise de 500 milliards de dollars pour l'IA de demain

Stargate d'OpenAI, une coentreprise de 500 milliards de dollars avec SoftBank, Oracle et MGX, construit le plus grand réseau d'infrastructure d'IA au monde pour alimenter la révolution de l'intelligence artificielle de demain.

Introl se classe 14ème sur 2025 Inc. 5000 avec une croissance de 9 594

Introl se classe au 14e rang de l'Inc. 5000 avec une croissance de 9 594 %, devenant ainsi le spécialiste de l'infrastructure GPU à la croissance la plus rapide en Amérique, alimentant la révolution de l'IA.

La révolution de l'infrastructure GPU en Inde : De 80 000 GPU à un investissement de 100 milliards de dollars

L'Inde déploie plus de 80 000 GPU avec un pipeline d'investissement de 100 milliards de dollars d'ici 2027, réalisant un TCAC de 34,4 % en tant que marché d'infrastructure d'IA à la croissance la plus rapide d'Asie.

NVIDIA Omniverse : Le système d'exploitation physique de l'IA à 50T

NVIDIA Omniverse équipe plus de 252 entreprises avec des gains d'efficacité de 30 à 70 %. L'OS d'IA physique, d'une valeur de 50 billions de dollars, transforme la fabrication, la robotique et les véhicules autonomes.

L'inférence FP4 de NVIDIA est 50 fois plus efficace

L'inférence FP4 offre une efficacité énergétique de 25 à 50 fois avec une réduction de la mémoire de 3,5 fois. DeepSeek-R1 atteint 250+ tokens/sec. L'ère du jeton à 0,02 $ arrive.

La révolution de l'IA de la Malaisie, d'une valeur de 15 milliards de dollars, alimente l'avenir numérique de l'Asie du Sud-Est

La Malaisie obtient plus de 15 milliards de dollars d'investissements dans l'IA et déploie la première plateforme GPU H100 de la région. Les géants de la technologie s'affrontent alors que Johor se transforme en centrale d'IA de l'Asie du Sud-Est.

Les petits réacteurs nucléaires modulaires (SMR) alimentent l'IA : une révolution nucléaire de 10 milliards de dollars transforme les centres de données

Les géants de la technologie s'engagent à investir plus de 10 milliards de dollars dans les petits réacteurs modulaires qui alimentent les centres de données de l'IA. Les premières installations SMR seront en service d'ici 2030, le nucléaire répondant à la demande énergétique de 945 TWh de l'IA.

La révolution de l'IA de 27 milliards de dollars de Singapour propulse l'Asie du Sud-Est en 2025

Singapour s'engage à verser 1,6 milliard de dollars de fonds publics et à investir 26 milliards de dollars dans la technologie pour devenir la plaque tournante de l'IA en Asie du Sud-Est, générant 15 % du chiffre d'affaires mondial de NVIDIA.